Fotos über eine KI zu generieren ist beeindruckend! Allerdings sind die Dienste hier vergleichsweise teuer, wie etwa Leonardo AI. Wenn du jedoch eine fähige Grafikkarte in deinem PC hast, kannst du Stable Diffusion lokal nutzen, um ebenfalls sehr hochwertige Bilder zu generieren. Dies ist aus Datenschutzsicht ideal.

Zwar ist die Nutzung von Stable Diffusion nicht unbedingt kompliziert, kann aber etwas trickreich sein, da du es über die Konsole installieren musst. Es geht jedoch einfacher mit dem Tool Stability Matrix. Stability Matrix ermöglicht es dir, unter anderem Stable Diffusion mit diversen UIs, Modellen usw. mit einem Klick Anfänger-freundlich zu installieren und zu nutzen.

Wollen wir uns Stability Matrix in diesem kleinen Artikel einmal näher ansehen.

Was ist Stability Matrix und Stable Diffusion?

Stability Matrix ist nach eigenen Worten ein „Multi-Platform Package Manager and Inference UI for Stable Diffusion“. Stable Diffusion ist ein Open-Source-KI-Tool, das Text in Bilder umwandelt. Das Ergebnis kann fotorealistisch oder künstlerisch sein, je nachdem, was du verlangst und welche Modelle du nutzt. Mit den richtigen Modellen/Checkpoints ist das Stable Diffusion-Programm äußerst mächtig und kann hochqualitative Bilder erzeugen, die kommerziellen Lösungen in nichts nachstehen! Von Haus aus ist Stable Diffusion auch unter Windows ein reines „Konsolen“-Programm ohne grafische Benutzeroberfläche und muss manuell installiert werden. Es gibt jedoch diverse Zusatztools, die Stable Diffusion eine benutzerfreundliche UI verleihen. Stability Matrix vereint nun diese Tools sowie Stable Diffusion selbst in einem einfachen Programm, das sich mit wenigen Klicks installieren lässt.

Hierdurch ist es auch für absolute Einsteiger kein Problem, Stable Diffusion zu nutzen.

Hardware-Anforderungen von Stability Matrix / Stable Diffusion

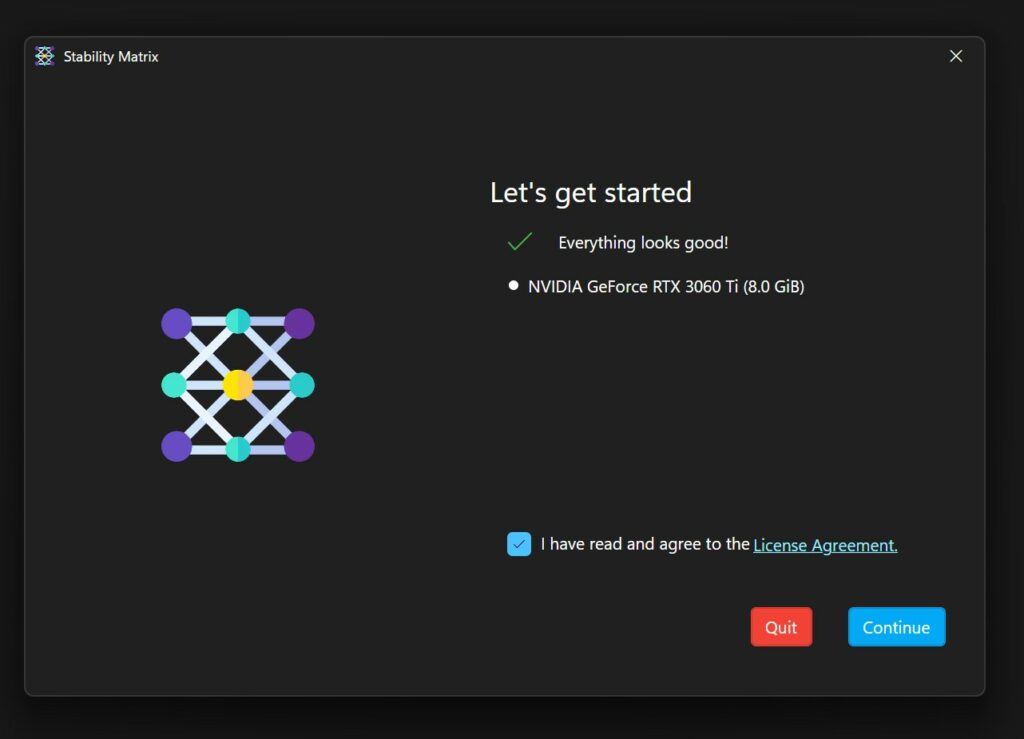

Stability Matrix ist für Windows, Mac und Linux verfügbar. Stable Diffusion ist bei den Hardware-Anforderungen etwas anspruchsvoller. Du benötigst einen PC mit einer Grafikkarte mit 4 GB oder mehr VRAM, idealerweise von NVIDIA. Modelle der RTX-Serie werden bevorzugt. Prinzipiell lässt sich Stable Diffusion auch mit AMD GPUs nutzen, jedoch kann dies teils etwas „zickiger“ und langsamer sein als mit NVIDIA GPUs. Je nach Grafikkarte arbeitet Stable Diffusion teils signifikant schneller oder langsamer. Nach meiner Erfahrung ist alles ab der NVIDIA RTX 3060 (Ti) gut nutzbar und ausreichend schnell.

Installation von Stability Matrix

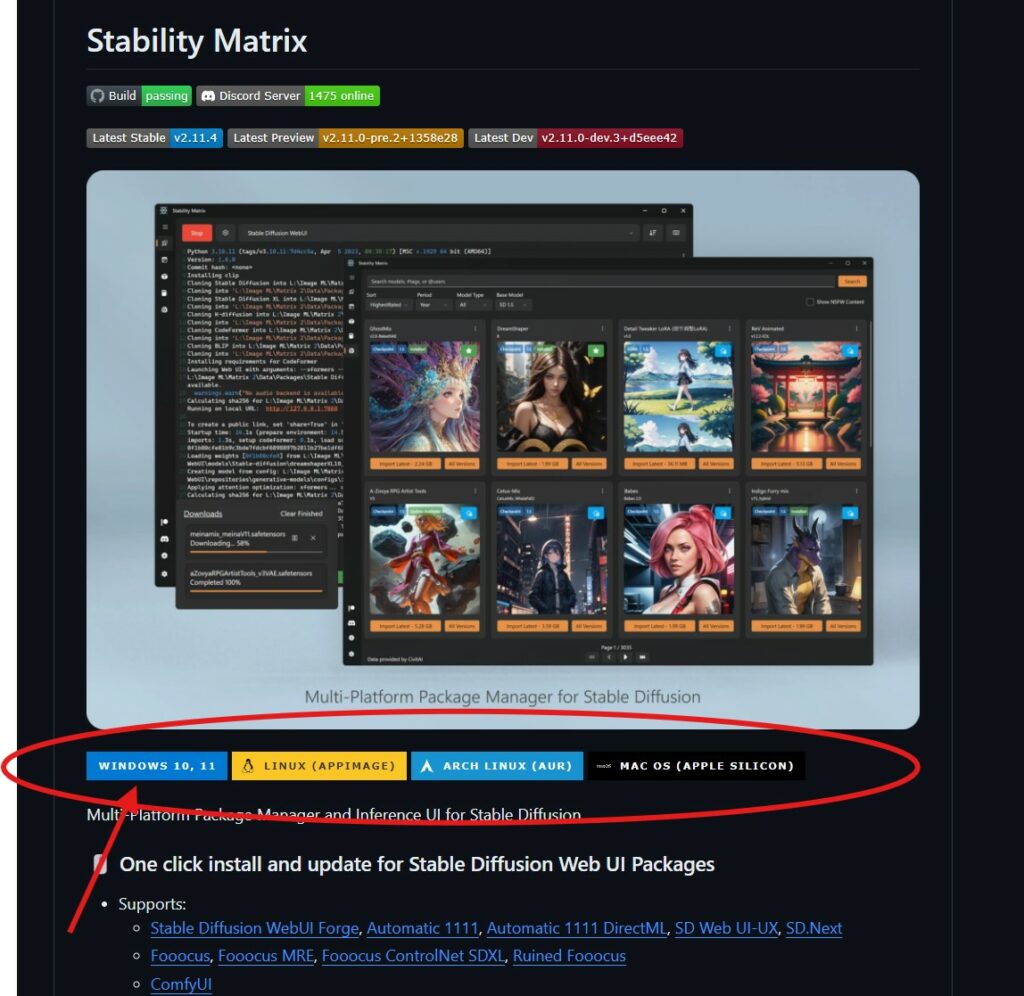

Zunächst musst du dir Stability Matrix von GitHub herunterladen: GitHub-Link

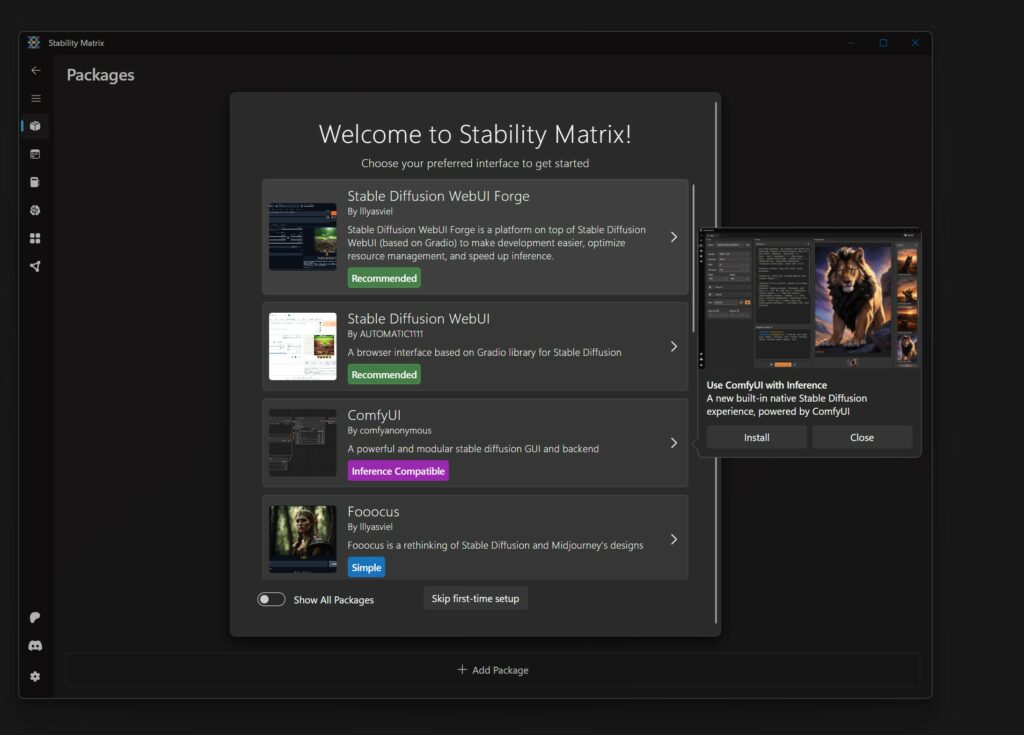

Anschließend erhältst du ein ZIP-Archiv, das du entpacken musst. Darin findest du die Installations-Datei. Es kann sein, dass der Windows Defender meckert, dass es sich um eine unbekannte Datei handelt; diese Meldung kannst du einfach „wegklicken“. Stability Matrix ist sauber; falls du meiner Einschätzung nicht traust, lade die Datei bei VirusTotal hoch. Dort kannst du sehen, dass alle großen Virenscanner bestätigen, dass Stability Matrix sauber ist. Nach dem Ausführen der Installationsdatei installiert sich Stability Matrix völlig automatisch und startet direkt. Beim ersten Start hast du die Wahl, welches Interface du haben möchtest. Du kannst problemlos später weitere ausprobieren, aber ich würde hier zum Start „FOOOCUS“ empfehlen. FOOOCUS ist sehr einsteigerfreundlich und hat sich bei mir als sehr zuverlässig erwiesen.

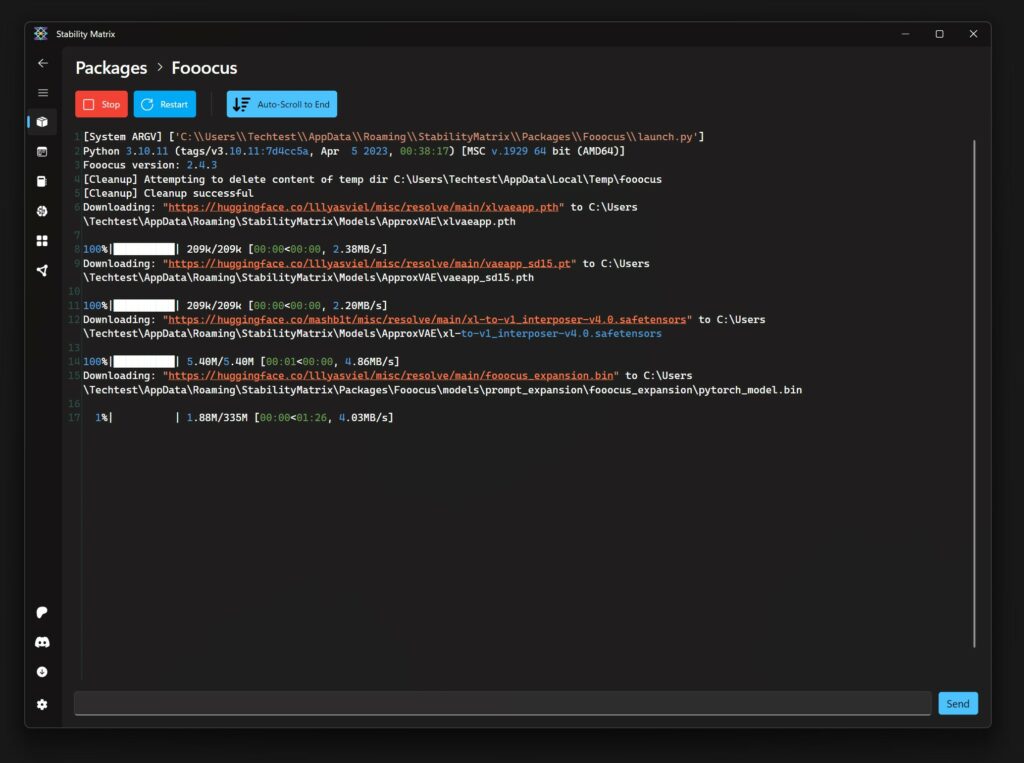

Anschließend werden dir bereits ein paar „Checkpoints“ zum Download angeboten. Hier würde ich epiCRealism XL empfehlen. Nun dauert es eine Weile, denn Stability Matrix lädt die benötigten Dateien automatisch herunter. Dies sind einige GB (ca. 6-8 GB). Ist der Download fertig, kannst du mit einem Klick FOOOCUS starten, welches dann auch beim ersten Start einige Daten automatisch herunterlädt. Hier brauchst du etwas Geduld.

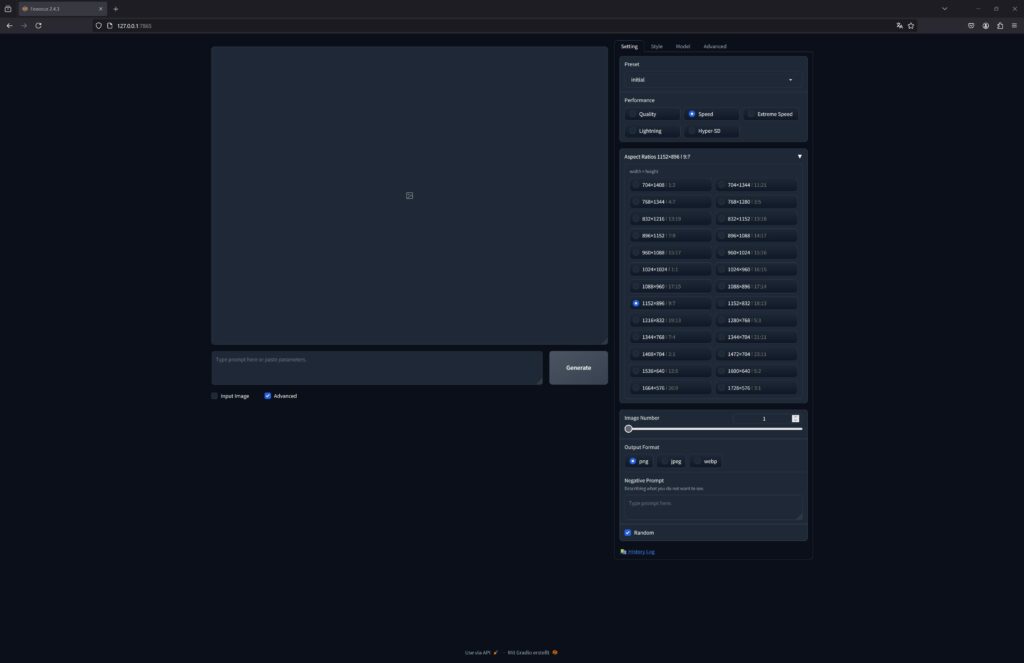

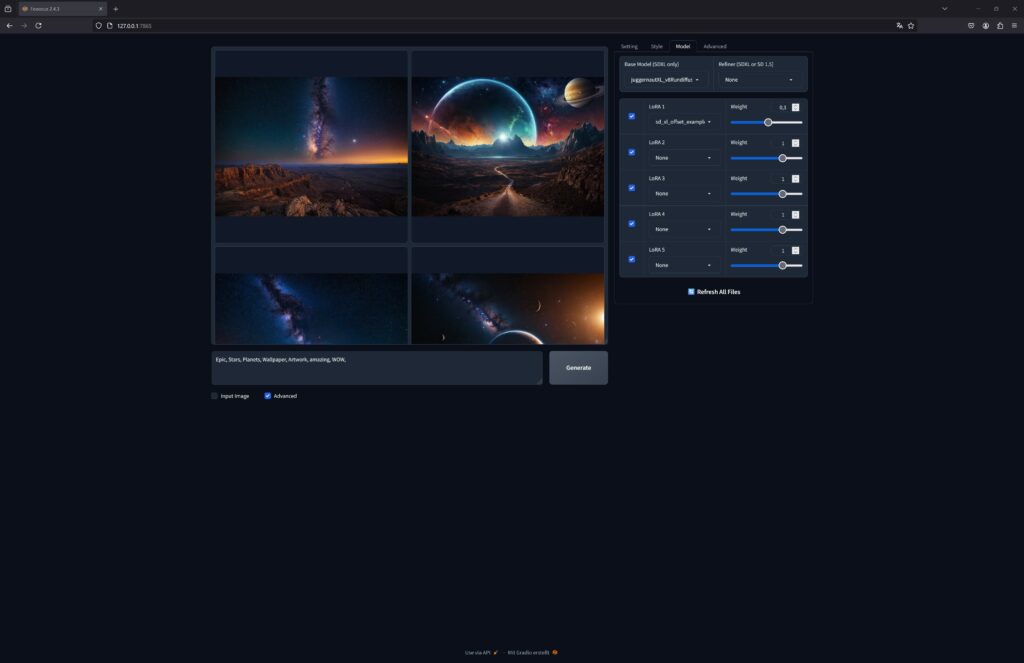

Ist alles heruntergeladen, sollte sich automatisch dein Webbrowser mit der Adresse „http://127.0.0.1:7865/“ öffnen. Unter dieser findest du die UI von FOOOCUS.

Das erste Bild via AI generieren

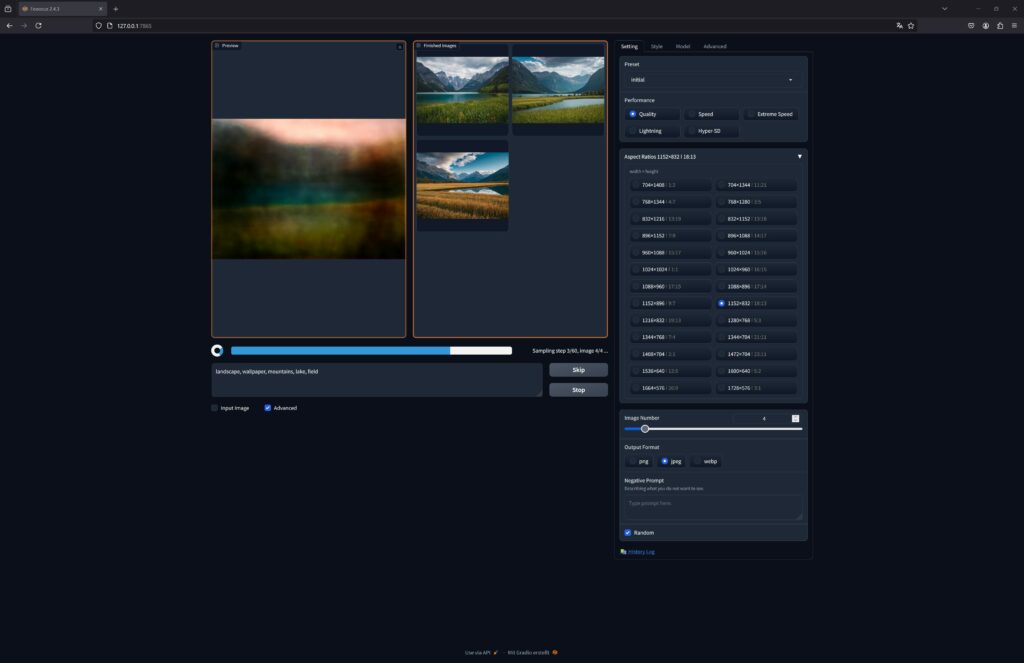

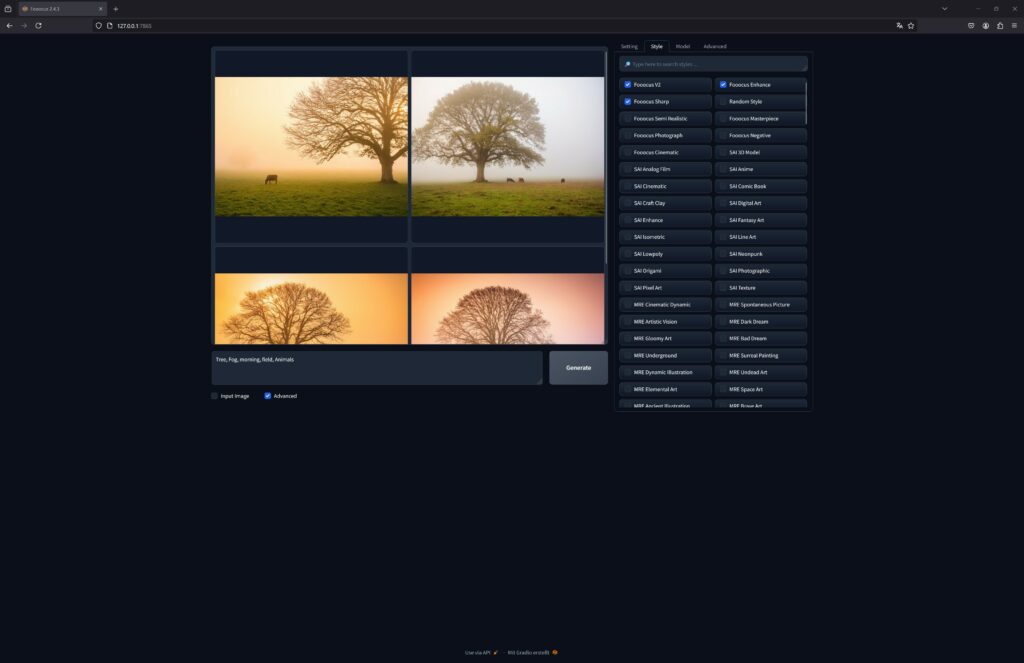

Wollen wir unser erstes Bild generieren. In FOOOCUS setze zunächst den Haken bei „Advanced“. Hier kannst du zunächst die Qualität einstellen.

Ich würde Speed oder Qualität empfehlen. Zudem kannst du die Auflösung und das Bildformat wählen und unter Preset die generelle Art des Bildes, das du generieren willst. Unter Model kannst du dann das „Base Model“ wählen, falls du bereits mehrere installiert hast. Dann kann es losgehen.

Du trägst unter dem Bild den Text ein, zu dem du ein Bild erzeugen möchtest (auf Englisch). Mit einem Klick auf „Generieren“ sollten dann die Bilder langsam auftauchen.

Was sind Modelle / Checkpoints?

Was sind diese Modelle bzw. genau genommen Checkpoints, von denen ich spreche? Checkpoints sind gespeicherte Zustände des neuronalen Netzwerks (Stable Diffusion), also quasi Schnappschüsse des Modells zu einem bestimmten Zeitpunkt während des Trainings. Diese Schnappschüsse werden von Nutzern über diverse Plattformen bereitgestellt, und je nachdem, mit welchen Bildern diese Checkpoints angelernt wurden, können die erstellten Bilder erheblich variieren.

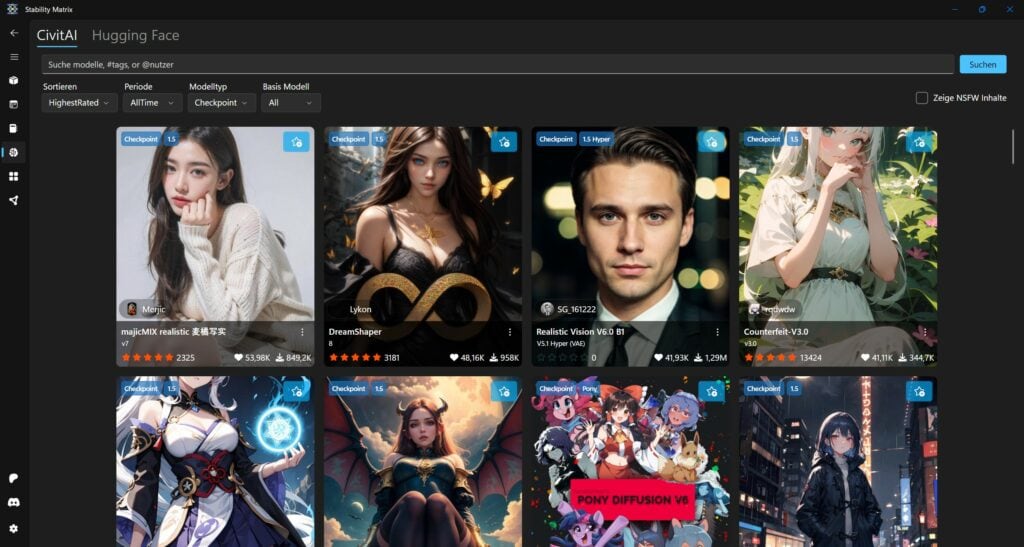

Woher bekommst du mehr Modelle / Checkpoints?

Die besten Anlaufstellen hierfür sind:

- Civitai – Civitai-Link

- Hugging Face – Hugging Face-Link

Die dort heruntergeladenen Modelle müssen unter „C:\Users\Michael\AppData\Roaming\StabilityMatrix\Models\StableDiffusion“ gespeichert werden. Dabei musst du natürlich „Michael“ mit deinem Benutzernamen austauschen. Alternativ kannst du auch Modelle direkt in Stability Matrix im Model Browser herunterladen.

Dies ist für den Anfang vielleicht sogar am einfachsten.

Relevante Einstellungen erklärt

An dieser Stelle eine kurze Erklärung einiger Einstellungen, die du kennen solltest, in Kombination mit der FOOOCUS UI.

Performance

Stable Diffusion erzeugt immer zunächst ein „Rauschen“, welches dann je nach deiner Texteingabe „aufgelöst wird“. Dabei wird dieses in mehreren Schritten immer weiter verfeinert. Je mehr Schritte das Modell durchführt, umso besser wird das Ergebnis. Die Performance-Einstellung entscheidet, wie viele Schritte durchgeführt werden. Quality beispielsweise führt 60 Schritte durch.

Base Model und Refiner

Über das Base Model haben wir ja schon gesprochen. Hierbei handelt es sich um den wichtigsten Faktor, was den generellen Style deines Bildes angeht. Neben dem Base Model kannst du auch ein zweites Modell als Refiner festlegen.

Der Refiner übernimmt das Bild vom Base Model und verfeinert es. Dies kann sinnvoll sein, wenn du beispielsweise ein Modell hast, das Posen und Szenen sehr gut erzeugen kann, und ein Modell, das Gesichter besonders realistisch erzeugen kann.

LoRA

LoRAs sind zusätzliche Modell-Dateien, die du speziell nutzen kannst, um Bilder nach deinen Wünschen zu erstellen. LoRAs findest du beispielsweise bei Civitai.

Guidance Scale

Guidance Scale ist eine sehr wichtige Einstellung. Je höher du diese stellst, umso „künstlerischer“ und kreativer, aber oftmals auch unrealistischer werden die Bilder. Hier kommt es wie üblich darauf an, was du dir wünschst. Hier ein paar Beispiele für die Auswirkungen.

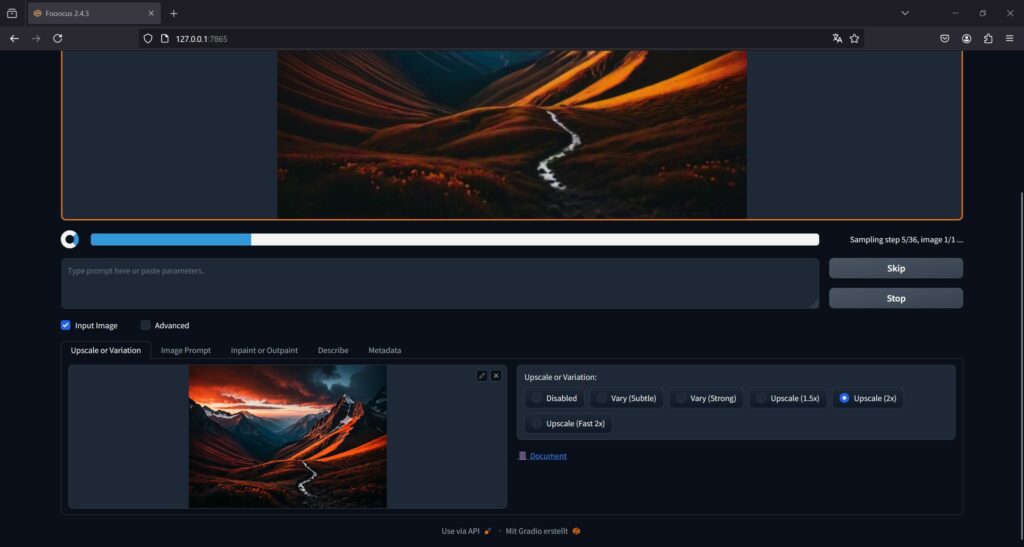

Auflösungen zu niedrig?

Vielleicht ist dir aufgefallen, dass die Auflösungen der generierten Bilder sehr niedrig sind. Beispielsweise arbeite ich hier mit 1216×832 Pixeln, also nicht einmal Full HD. Dies ist weitestgehend normal. Die meisten KI-Modelle generieren sehr niedrig aufgelöste Bilder. Was aber, wenn du mehr Auflösung willst? Kein Problem!

Wähle „Input Image“, wo du dann „Upscale (2x)“ auswählen kannst. Dort kannst du dein Bild von der KI noch einmal hochrechnen lassen. Unter „Input Image“ kannst du auch ähnliche Bilder zu einem Bild generieren lassen, das du bereits hast, oder Bilder „verändern“ lassen.

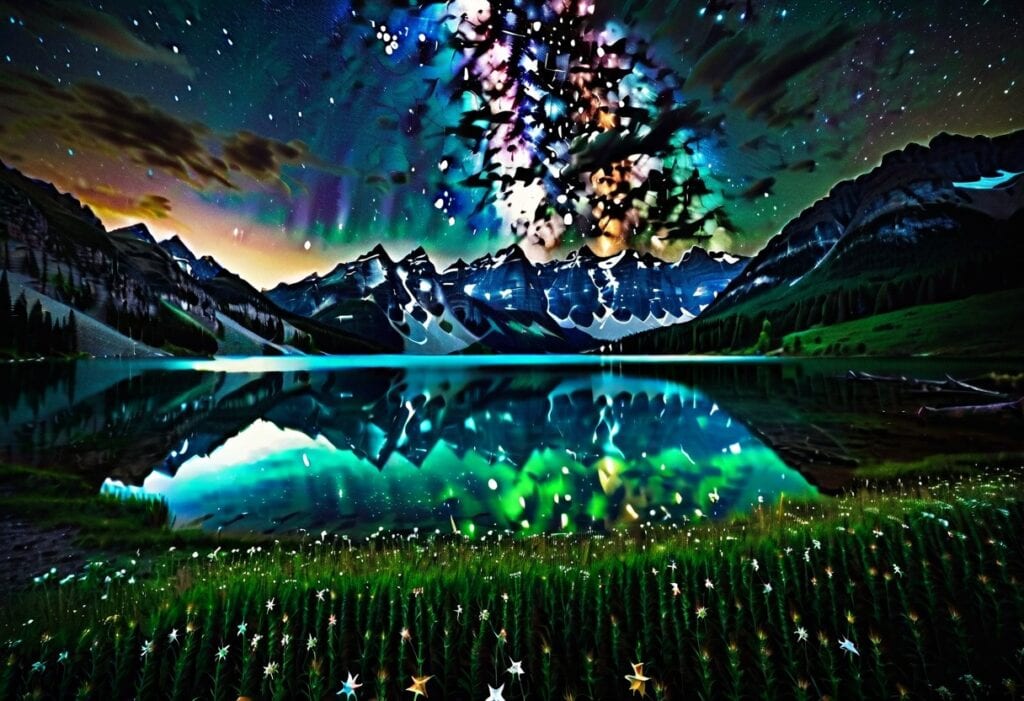

Ein paar Beispielbilder

An dieser Stelle einfach ein paar Beispielbilder, die ich mit diesem Setup und dem epiCRealism XL Modell erstellt habe.

Epic, Wallpaper Mountains, Stars, Planets, Dramatic

Mountains, Lake, Trees, Sunset

Female, looking at Stars, Epic, Si-Fi, Wallpaper, Artwork

Lion, realistic, Africa, photo, Picture, Canon

Berlin, City, Night, Lights, Rain, Dark, realistic, real, Photo, shot on iPhone

Munich, City, Day, Sunny, realistic, real, Photo, shot on iPhone

Pirate ship, ocean, realistic, waves, pirates, photorealistic

Poppy field, woman, beautiful, colorful, day, sun, mountains in the background, realistic, professional photoshoot

Swiss Mountain Dog, Sennenhund, Schweiz, Alpen, Berge, Photo, realistisch

Ich denke, diese Bilder zeigen bereits gut, was dieses System in der Lage ist zu leisten, auch ohne ein spezielles Modell oder LoRA genutzt zu haben.

Fazit

Mit Stability Matrix ist es kinderleicht, lokal Bilder mithilfe einer KI zu generieren. Stability Matrix übernimmt die ansonsten teils etwas „fummelige“ Installation von Stable Diffusion und einer passenden WebUI komplett für dich.

Alles geschieht mit wenigen Klicks ohne Fachwissen. Stability Matrix lädt alle benötigten Pakete und Dateien herunter, und du kannst dich auf das Erstellen von Bildern konzentrieren. Dabei sind diese qualitativ oftmals wirklich beeindruckend gut! Ich hoffe, diese Anleitung konnte auch den Anfängern von euch weiterhelfen, Bilder lokal zu generieren.